L’aumento dell’accuratezza numerica nelle simulazioni CFD e FEM non garantisce di per sé una migliore rappresentazione della realtà fisica o strutturale. Al contrario, un errore concettuale nella costruzione del modello può essere mascherato da risultati convergenti e formalmente corretti, generando un’illusione di affidabilità. L’articolo analizza il rapporto tra accuratezza numerica e validità del modello, discutendo esempi tipici di errori concettuali e sottolineando il ruolo centrale del giudizio ingegneristico e della validazione critica dei risultati.

Negli ultimi decenni la simulazione numerica è diventata uno strumento centrale nell’attività dell’ingegnere. Software sempre più performanti, interfacce orientate all’utente e una crescente disponibilità di risorse computazionali hanno reso l’analisi CFD e FEM uno strumento di uso corrente nella pratica ingegneristica. La possibilità di incrementare il livello di dettaglio del modello — attraverso il raffinamento della discretizzazione, l’impiego di elementi di ordine elevato o l’adozione di formulazioni sempre più sofisticate — ha progressivamente consolidato l’idea che l’accuratezza numerica sia di per sé indicativa della qualità del risultato.

Questa convinzione è tuttavia solo parzialmente fondata. Un risultato può dirsi numericamente accurato esclusivamente in relazione al modello matematico e alle ipotesi che lo definiscono. Quando tali ipotesi risultano inadeguate o concettualmente errate, l’aumento dell’accuratezza non migliora la rappresentazione del fenomeno reale, ma tende piuttosto a consolidare l’errore, rendendolo meno evidente. Si genera così un’illusione di affidabilità, in cui soluzioni stabili, convergenti e formalmente corrette mascherano una sostanziale incoerenza fisica.

Questo fenomeno risulta particolarmente insidioso poiché si manifesta in modo silenzioso. A differenza degli errori macroscopici, che conducono a risultati immediatamente non plausibili, l’illusione dell’accuratezza numerica produce soluzioni formalmente corrette, graficamente curate e spesso convincenti anche per un lettore esperto. Il rischio non è quindi quello di commettere un errore evidente, ma di consolidare un risultato errato con un elevato grado di fiducia.

L’obiettivo di questo articolo è analizzare il concetto di accuratezza numerica distinguendolo dalla validità del modello, mostrando come molte criticità della simulazione ingegneristica non derivino dai metodi di calcolo, ma dalla costruzione concettuale del modello stesso. Attraverso esempi e considerazioni applicabili sia alla CFD sia all’analisi agli elementi finiti, si intende riportare l’attenzione sul ruolo centrale del giudizio ingegneristico nel processo di modellazione.

Accuratezza numerica e validità del modello

Nel linguaggio comune dell’ingegneria computazionale, il termine “accuratezza” viene spesso utilizzato in modo generico, come sinonimo di qualità o affidabilità del risultato. In realtà, è possibile distinguere almeno tre livelli di errore, concettualmente diversi e tra loro indipendenti:

- Errore numerico, legato allo schema di discretizzazione, alla risoluzione della mesh, al passo temporale e agli algoritmi di soluzione;

- Errore di modello, dovuto alle ipotesi fisiche, costitutive, cinematiche e geometriche adottate;

- Errore di interpretazione, che nasce dalla lettura acritica o decontestualizzata dei risultati.

L’accuratezza numerica riguarda esclusivamente il primo livello. Essa misura quanto fedelmente il metodo numerico risolve le equazioni che gli vengono fornite, non quanto tali equazioni rappresentino correttamente la realtà fisica o strutturale di interesse. Un’analisi può quindi essere numericamente molto accurata – ad esempio mostrando una chiara convergenza al raffinamento della mesh – pur essendo affetta da un errore di modello significativo.

Il problema nasce quando l’ingegnere attribuisce alla convergenza numerica un significato che essa non possiede: la conferma della bontà del modello concettuale. Questa sovrapposizione impropria è una delle principali cause di risultati apparentemente affidabili ma ingegneristicamente fuorvianti. La convergenza, infatti, è una condizione necessaria ma non sufficiente per la validità del risultato.

In questo contesto è utile ricordare che ogni modello numerico è, per definizione, una rappresentazione parziale e semplificata della realtà. La qualità di tale rappresentazione dipende più dalle scelte concettuali iniziali che dal livello di dettaglio numerico raggiunto in fase di calcolo.

Il ruolo delle ipotesi nella costruzione del modello

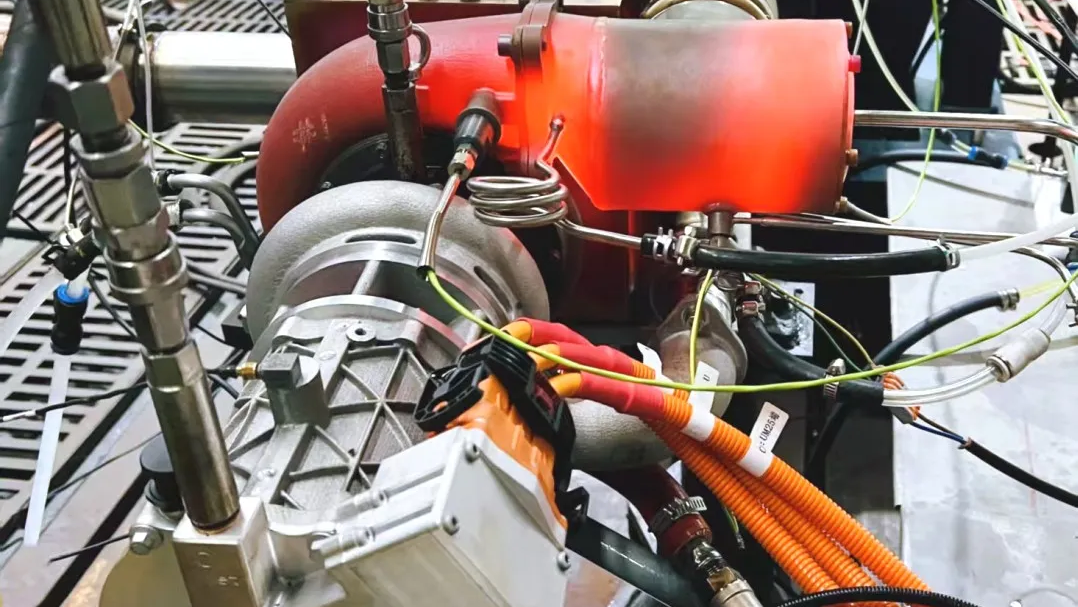

Ogni simulazione nasce da una serie di ipotesi, spesso implicite, che definiscono il perimetro di validità del modello. Queste ipotesi riguardano il comportamento del materiale o del fluido, la scala temporale e spaziale del fenomeno, le condizioni al contorno e le interazioni con l’ambiente circostante. Ad esempio, in un’analisi CFD può essere assunto che il flusso sia stazionario o che la turbolenza possa essere descritta da un modello RANS, mentre in realtà il fenomeno è instazionario e caratterizzato da vortici di piccola scala; analogamente, in un’analisi FEM si può considerare un materiale come linearmente elastico o isotropo, mentre nella realtà presenta comportamento plastico o anisotropico.

Molte di queste assunzioni vengono date per scontate, soprattutto quando si utilizzano modelli standard o procedure consolidate, come librerie di materiali predefiniti, condizioni al contorno uniformi o schemi di contatto semplificati. Tuttavia, è proprio in questa fase che si annidano gli errori concettuali più pericolosi. Un esempio tipico nella CFD è l’uso di simulazioni turbolente per flussi invece laminari. Siccome il 90 % delle analisi riguarda appunto flussi turbolenti, capita di applicare questa ipotesi in maniera automatica, senza prima verificarla, con ovviamente l’effetto di trovare un risultato coerente con l’ipotesi, ma distante dalla realtà.

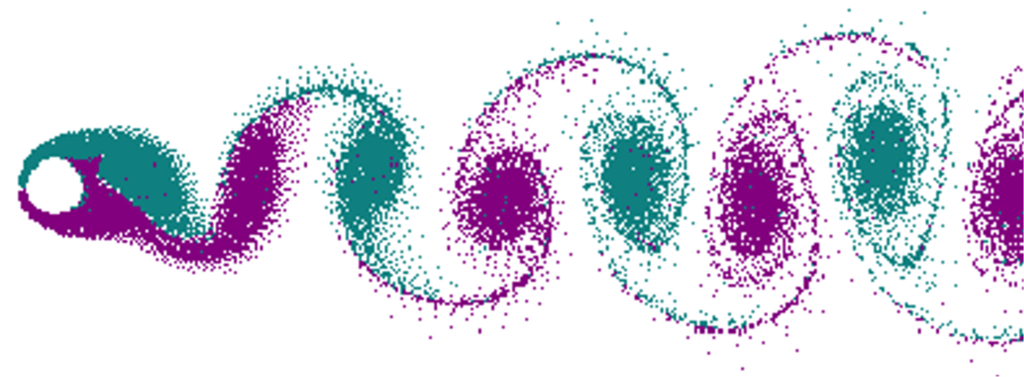

Anche l’ipotesi di simmetria deve essere attentamente valutata. Nella maggior parte delle simulazioni, se la geometria è simmetrica e le condizioni al contorno pure, il campo di moto è simmetrico. Esistono alcuni casi specifici dove questo non è vero, come per esempio un cilindro investito da un flusso constante. In questo caso, per esempio, in alcune condizioni di moto turbolento, si instaurano dei vortici fortemente asimmetrici. Utilizzare l’ipotesi di simmetria e quindi simulare solo metà della geometria porterebbe a una simulazione convergente, ma significativamente differente dal risultato reale.

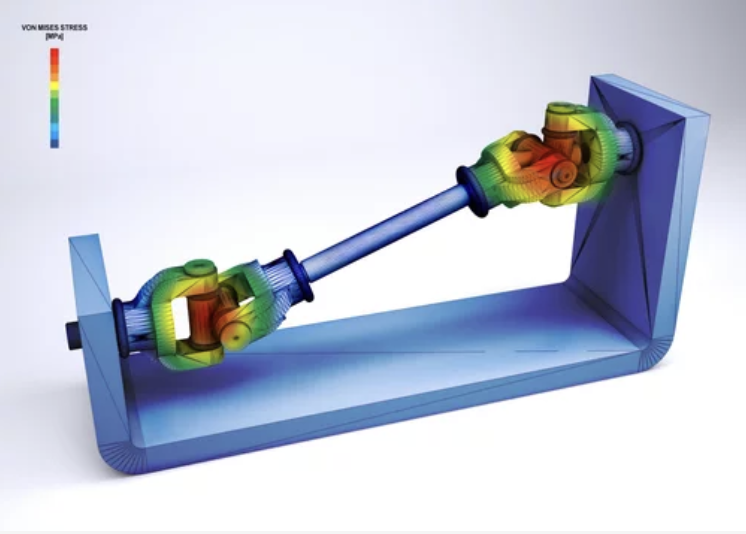

Nel FEM, un vincolo applicato come perfettamente rigido può produrre deformazioni e sollecitazioni “numericamente corrette” ma completamente diverse da quelle osservabili in un componente reale, come nel caso di giunzioni bullonate o cerniere parzialmente vincolate.

Anche l’assunzione di un materiale perfettamente elastico e lineare può generare campi di tensione regolari e convergenti che, tuttavia, non rappresentano il comportamento reale del componente una volta superata la soglia di snervamento. In presenza di plasticizzazione locale, fessurazione o danneggiamento progressivo, il modello continua a fornire risultati “corretti” dal punto di vista numerico, ma fisicamente fuorvianti, poiché ignora i meccanismi che governano la risposta strutturale reale.

Un’ipotesi errata o non verificata non viene corretta da un raffinamento numerico: aumentare il numero di celle nella mesh o usare elementi di ordine superiore non modifica la validità concettuale del modello, ma semplicemente produce una soluzione più precisa di equazioni potenzialmente fuorvianti. Allo stesso modo, l’aggiunta di termini complessi a un modello costitutivo non compensa l’errore di fondo derivante da una scelta inadeguata di vincoli o condizioni al contorno.

La consapevolezza delle ipotesi adottate e dei loro limiti di validità rappresenta quindi un passaggio fondamentale del processo di modellazione, spesso trascurato nella pratica quotidiana. Solo interrogandosi criticamente su cosa viene semplificato e perché è possibile evitare l’illusione dell’accuratezza numerica, progettando simulazioni che siano non solo precise, ma anche fisicamente significative.

La validazione come processo critico

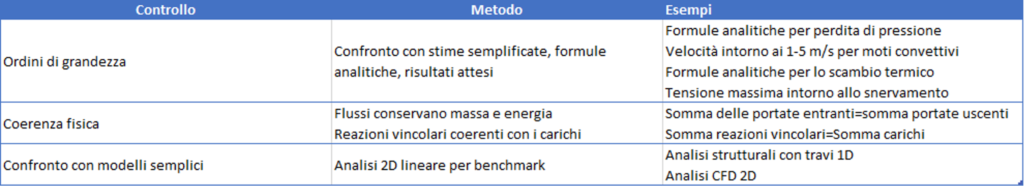

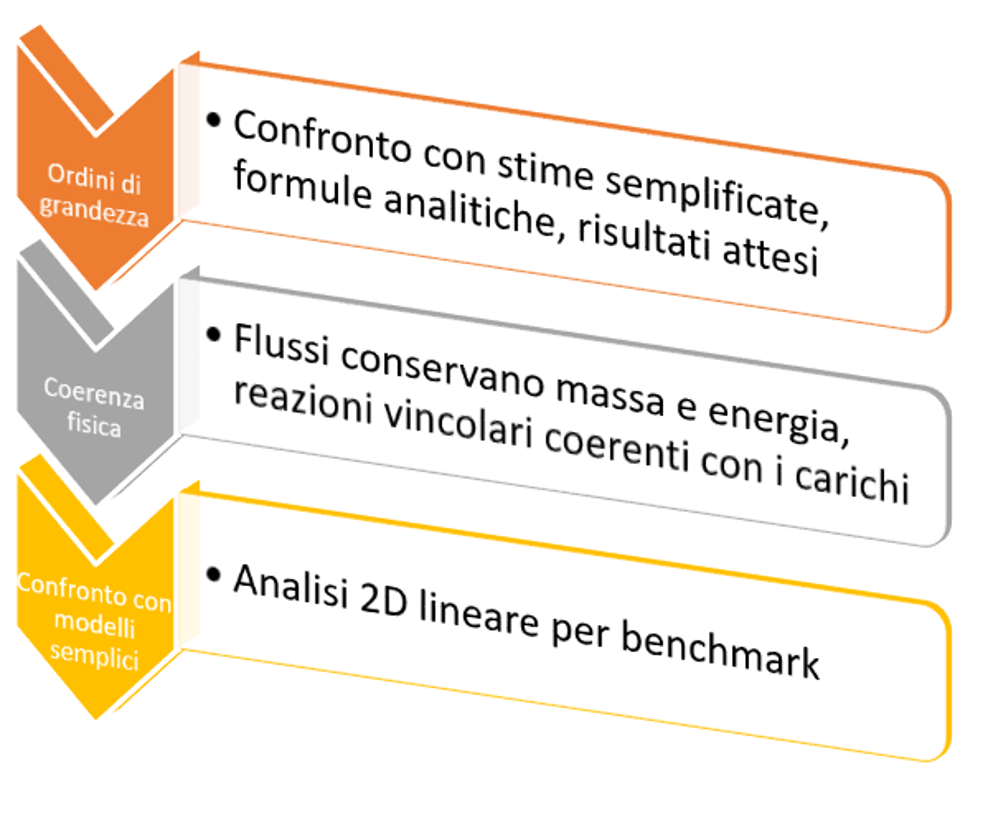

La validazione critica rappresenta l’unico vero antidoto all’illusione dell’accuratezza numerica. Essa non deve essere intesa esclusivamente come un confronto puntuale con dati sperimentali, spesso non disponibili o difficili da ottenere, ma come un processo più ampio e strutturato che mira a verificare la coerenza e la significatività del modello. La validazione comprende diverse attività complementari, ciascuna delle quali contribuisce a garantire che il risultato non sia soltanto formalmente corretto, ma anche fisicamente affidabile.

Naturalmente, la prima strategia da adottare nei processi di simulazione consiste nell’assumere un approccio fortemente critico nei confronti dei risultati: considerarli inizialmente come potenzialmente errati e riconoscerne la correttezza solo dopo aver raccolto prove indipendenti e coerenti a sostegno della loro validità. Questo atteggiamento permette di mantenere costantemente il controllo sul modello e di evitare che la fiducia nel software sostituisca il giudizio ingegneristico necessario per interpretare correttamente i risultati.

In primo luogo, il controllo degli ordini di grandezza permette di verificare rapidamente se i valori calcolati rientrano in un range plausibile rispetto all’esperienza, alla letteratura o a dati semplificati. Ad esempio, in una simulazione CFD, un coefficiente di perdita di pressione estremamente basso o elevato rispetto alle stime teoriche o sperimentali può indicare problemi nella definizione del dominio, nelle condizioni al contorno o nel modello di turbolenza. Analogamente, in un’analisi FEM, sollecitazioni o deformazioni fuori scala possono segnalare vincoli eccessivi, errori nella geometria o nella scelta del materiale.

La coerenza fisica dei campi di risultato rappresenta un secondo livello di controllo. Non basta che i valori numerici siano plausibili; devono anche rispettare i principi fisici fondamentali, come la conservazione di massa, energia o momento, e seguire pattern attesi. In CFD, ad esempio, flussi vorticosi che emergono in regioni in cui non dovrebbero apparire possono indicare instabilità numeriche o discrepanze concettuali. In FEM, deformazioni locali incoerenti con il comportamento globale della struttura possono rivelare vincoli o connessioni mal modellati.

Un terzo elemento è il confronto con modelli semplificati o soluzioni analitiche, quando disponibili. Anche modelli ridotti, lineari o bidimensionali possono fornire benchmark preziosi per verificare la correttezza generale della simulazione complessa. Per esempio, il confronto tra la caduta di pressione calcolata in un condotto semplice tramite analisi CFD completa e quella ottenuta da formule di perdita note permette di identificare deviazioni significative che potrebbero sfuggire a un controllo basato solo sui numeri.

Infine, l’analisi di sensitività rispetto alle ipotesi principali consente di comprendere quanto i risultati dipendano dalle scelte concettuali effettuate: materiale, condizioni al contorno, modelli di turbolenza, schemi di vincolo. Variazioni di questi parametri in un intervallo ragionevole possono evidenziare quali ipotesi siano determinanti e quali invece trascurabili, aiutando a distinguere le zone di confidenza del modello da quelle più critiche.

Questo approccio richiede tempo, esperienza e una solida cultura ingegneristica, ma rappresenta l’unico modo per separare un risultato numericamente elegante da uno realmente significativo. Solo attraverso una verifica sistematica e critica è possibile trasformare la simulazione in uno strumento affidabile di progettazione e comprensione, evitando che la precisione formale diventi un surrogato dell’intelligenza ingegneristica.

Il ruolo dell’ingegnere nell’era del software

La crescente automazione degli strumenti di simulazione tende a spostare l’attenzione dall’interpretazione del fenomeno alla semplice gestione del software. In questo contesto, il rischio concreto è quello di confondere la padronanza operativa dello strumento con la reale comprensione del problema fisico o strutturale analizzato, delegando al calcolo numerico decisioni che dovrebbero rimanere di natura ingegneristica. Il valore aggiunto dell’ingegnere non risiede nella capacità di ottenere risultati numericamente raffinati, ma nella capacità di formulare correttamente il problema, selezionare ipotesi coerenti con il fenomeno studiato e interpretare i risultati in modo critico, consapevole e puntuale, valutandone limiti e ambiti di validità.

Conclusioni

L’accuratezza numerica è una qualità fondamentale della simulazione, ma non può essere considerata un fine in sé. Un modello numericamente accurato ma concettualmente errato rischia di produrre risultati più pericolosi di un modello grossolano ma fisicamente coerente.

In un contesto in cui il software tende a semplificare e automatizzare il processo di analisi, il ruolo dell’ingegnere non è quello di spingere i limiti del calcolo, ma di mantenere il controllo concettuale del modello. Solo riportando la comprensione del fenomeno al centro della simulazione è possibile evitare l’illusione dell’accuratezza numerica e restituire al modello il suo vero ruolo: quello di strumento di interpretazione della realtà, non di sua sostituzione.